Wie heißt es so schön: Immer wenn sich eine Tür schließt, öffnet sich eine neue.

Auf dem Fedorablog habe ich gestern das letzte Posting geschrieben. Die Site werde ich voraussichtlich Ende September schließen. Amerikanische Firmen müssen ihre Marke verteidigen, sonst verlieren sie sie. Die Erfahrung durfte ich 1998 schon mit der Firma Palm machen, und jetzt halt wieder. Wobei Red Hat sich da wesentlich community-freundlicher benimmt! Allerdings ist der Vertrag in amerikanischem Legalese geschrieben, und verlangt auch die dort üblichen Markenzeichen-Symbole (wie “Fedora®”). Im Endeffekt also viel Aufwand, nur um in Lizenz eine Domain benutzen zu dürfen. Wozu?

Ich sehe den Umzug in meinen privaten Blog eher als einen Neuanfang… Den Nachrichtenumfang vom Fedorablog werde ich (schon aus Zeitgründen) nicht beibehalten, also nicht die Release jeder Alpha-, Beta oder Final ankündigen oder es melden, wenn yum mal wieder klemmt.

Andererseits: Das Fedorablog repräsentierte die Community, weshalb ich meine persönliche Meinung weitgehend in den Hintergrund gestellt hatte. In meinem persönlichen Blog brauche ich auf solche Sachen nicht mehr zu achten. Auch nicht schlecht…

Wie geht es jetzt weiter? Ich werde die Artikel im Fedorablog sichten. Vieles davon ist mittlerweile obsolet (zum Beispiel, dass Fedora 7 veröffentlicht wurde) und kann an sich weg. Andere Artikel werde ich in das Fedora Wiki stellen oder hier in das Blog übernehmen. Die ganzen Arbeiten werde ich im Oktober erst beginnen können, also bitte ein wenig Geduld. 😀

Neue Artikel zum Thema Fedora (und weiteren Linux-Distributionen) wird es unter der Kategorie “Fedorado” geben. (Danke an Jan Ehrhardt für diese geniale Idee.)

Und zu der “Primer”-Kategorie aus dem Fedorablog, die bei dem Setup eines neu installierten System hilfreich ist, lasse ich mir auch noch etwas einfallen.

Der Linux-Kern hat den Ruf, äußerst stabil zu sein. Der X-Server dagegen bleibt gelegentlich hängen, vor allem in der Beta-Version, die seit Fedora 9 installiert wird. Der Rechner reagiert dann auf keine Eingaben mehr, und der einzige Ausweg scheint eine Zwangsabschaltung zu sein. Der Kernel “lebt” aber meist noch. Dann hilft die Magische S-Abf-Taste, um das System kontrolliert herunterzufahren.

Diese Funktion ist bei Fedora standardmäßig abgeschaltet. Um sie zu aktivieren, öffnet man als root die Datei /etc/sysctl.conf und ändert dort die Zeile kernel.sysrq wie folgt ab:

kernel.sysrq = 1

Nach einem Neustart steht die Taste zur Verfügung. Zusätzlich kann sie mit dem Kommando echo 1 > /proc/sys/kernel/sysrq sofort aktiviert werden.

Sollte sich das System dann wieder einmal aufhängen, hält man die Tasten ALT und S-Abf gedrückt und tippt ganz langsam die Buchstabenfolge REISUB ein. Wenn alles gut gegangen ist, startet das System neu. Die Buchstabenkombination lässt sich mit einer kleinen Eselsbrücke merken: “Raising Elephants Is So Utterly Boring”.

Proportional zu der Größe der Festplatte nimmt meist auch der Müll zu, der darauf abgelegt wurde. Irgendwann verliert man dann den Überblick darüber, welche Dateien man bereits hat.

Proportional zu der Größe der Festplatte nimmt meist auch der Müll zu, der darauf abgelegt wurde. Irgendwann verliert man dann den Überblick darüber, welche Dateien man bereits hat.

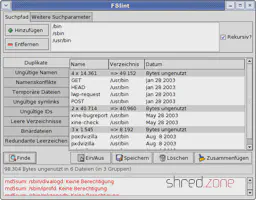

FSlint hilft dabei, die Unordnung zu lichten. Neben einigen anderen Möglichkeiten bietet es an, einen Verzeichnisbaum nach Dateiduplikaten zu durchsuchen. Installiert wird es mit yum install fslint. Danach kann es unter Anwendungen → Systemwerkzeuge → FSlint gestartet werden. Leider ist die deutsche Übersetzung des Programmes nicht immer gelungen.

Im ersten Schritt wählt man oben den Suchpfad aus, also das zu durchsuchende Basisverzeichnis. Es können auch mehrere Verzeichnisse angegeben oder in den weiteren Suchparametern gezielt ausgeschlossen werden. Anschließend wählt man links den Modus Duplikate und klickt dann unten auf Finde. FSlint durchsucht nun den Pfad nach Dateien, die einen identischen Inhalt haben, und listet diese der Größe nach absteigend sortiert auf.

Überflüssige Dateien können jetzt in der Liste markiert werden. Über den Knopf ausgewählt stehen außerdem verschiedene Auswahlhilfen zur Verfügung. Die ausgewählten Dateinamen können anschließend über Speichern in eine Datei geschrieben werden. Mit Löschen werden die ausgewählten Dateien stattdessen gleich gelöscht.

Zusammenfügen schließlich lässt die Duplikate über so genannte hard links auf die ausgewählte Datei verweisen. Sie scheinen dadurch weiterhin mehrmals zu existieren, werden aber nur einmal auf der Festplatte abgelegt. Ein möglicherweise ungewünschter Nebeneffekt ist, dass sich, sobald eine der Dateien verändert wird, die anderen ebenfalls verändern. Sie sind keine eigenständigen Kopien mehr.

Im Verzeichnis /usr/share/fslint/fslint/ stehen die einzelnen FSlint-Module auch für die Kommandozeile zur Verfügung. Ein ähnliches Tool ist fdupes. Es lässt sich über yum install fdupes installieren und kann dann zum Beispiel in Scripten verwendet werden. Eine weitere Hilfe beim Aufräumen ist Baobab.

Bei Digitalfotografen derzeit sehr beliebt sind die so genannten High Dynamic Range-Fotografien. Durch einen Trick wird hierbei der Kontrastumfang einer Aufnahme stark erhöht. Details bleiben an hellen wie an dunklen Stellen sichtbar, wo sie bei einem normalen Foto sonst in sattes Weiß oder Schwarz übergehen.

Bei Digitalfotografen derzeit sehr beliebt sind die so genannten High Dynamic Range-Fotografien. Durch einen Trick wird hierbei der Kontrastumfang einer Aufnahme stark erhöht. Details bleiben an hellen wie an dunklen Stellen sichtbar, wo sie bei einem normalen Foto sonst in sattes Weiß oder Schwarz übergehen.

Spiegel Online widmete dem Thema bereits mehrere Artikel - beeindruckende Fotostrecken mit Leserfotos inklusive. Eine weitere Galerie gibt es bei Chip Online . Wer Spaß an dem Hobby findet, kann sich auch verschiedenen Communities anschließen und sich mit anderen HDR-Fotografen austauschen.

Der Spaß ist nicht nur Windows-Anwendern vorbehalten. Wie man mit Linux zu seinen HDR-Fotos kommt, beschreibt dieses Special.

Was ist HDR-Fotografie?

Unsere Augen erlauben es uns, selbst an hellen Sommertagen Details im Himmel wie auch an dunklen, schattigen Stellen wahrzunehmen. Kameras sind dazu nicht in der Lage. Sie haben nur einen begrenzten Kontrastumfang, den sie darstellen können. Alles, was über diesen Bereich hinausgeht, wird nur noch als sattes Weiß oder Schwarz dargestellt, die Bilddetails gehen dort verloren.

Bei der HDR-Fotografie begegnet man diesem Problem mit einem Trick: Man nimmt vom gleichen Motiv mehrere Bilder in verschiedenen Belichtungsstufen auf. Auf den unterbelichteten Bildern bleiben helle Details erhalten, während auf den überbelichteten Bildern dunkle Details erhalten bleiben.

Bei der HDR-Fotografie begegnet man diesem Problem mit einem Trick: Man nimmt vom gleichen Motiv mehrere Bilder in verschiedenen Belichtungsstufen auf. Auf den unterbelichteten Bildern bleiben helle Details erhalten, während auf den überbelichteten Bildern dunkle Details erhalten bleiben.

Eine spezielle Software setzt diese Bilder anschließend zu einem einzigen HDR-Bild zusammen. Durch den hohen Kontrastumfang des Bildes ist es allerdings auf herkömmliche Weise nicht mehr darstellbar - 16 Millionen Farben reichen dafür bei Weitem nicht aus.

Um das Bild wieder darstellbar zu machen, wandelt man es mit einem tonemapping genannten Verfahren in ein LDR-Bild (Low Dynamic Range, zum Beispiel eine JPEG-Datei) zurück. Die Software bewertet dafür jede Stelle der HDR-Vorlage einzeln und ändert die Belichtung punktuell so ab, dass alle Details wiedergegeben werden. So wird die große Dynamik, die die HDR-Vorlage hergab, in ein gewöhnliches Bild “gepresst”. Im Ergebnis sind dann die Details an hellen wie an dunklen Stellen sichtbar. Diese Bilder üben auf den Betrachter einen ganz besonderen Reiz aus, obwohl (oder gerade weil) sie unnatürlich aussehen.

Die Ausrüstung

Um HDR-Bilder anzufertigen, braucht man keine teure Ausrüstung. Fast alle einfachen Digitalknipsen der unteren Preisklasse bieten bereits eine zumindest rudimentäre Belichtungssteuerung, die für die ersten Schritte ausreicht. Da man das gleiche Motiv mehrfach fotografiert, wird man allerdings um ein Stativ nicht herumkommen. Sehr hilfreich ist auch ein Fernauslöser.

Gute HDR-Bilder lassen sich nur mit Digitalkameras ab der Mittelklasse machen, die eine manuelle Belichtung (also die manuelle Auswahl von Blende und Belichtungszeit) erlauben. Hilfreich in manchen Situationen, aber keine Voraussetzung ist es außerdem, Belichtungsreihen anfertigen zu können oder die Bilder im RAW-Format auf der Speicherkarte abspeichern zu können.

Das Motiv und die Aufnahme

Um die Vorzüge von HDR-Aufnahmen voll ausspielen zu können, braucht man zunächst mal eines: Ein Motiv mit einem hohen Kontrastumfang. Das können Außenaufnahmen von Gebäuden bei leicht bewölktem Himmel sein, wo die Wolken genauso detailreich zu sehen sein sollen wie im Schatten liegende Gebäudeteile. Beliebt sind auch Innenaufnahmen zum Beispiel von Kirchen, wo bei herkömmlicher Aufnahmetechnik die Fenster meist nur als blendend weiße homogene Fläche erscheinen. Vielleicht nicht ganz so nahe liegend sind Nachtaufnahmen, wo einerseits die Landschaft im Dunkeln liegt, andererseits aber Scheinwerfer, Reklametafeln oder Straßenlaternen ein helles Licht abgeben. Hier ist die Kamera im Vorteil gegenüber dem menschlichen Auge, das im Dunkeln weniger wahrnimmt.

Da mehrere Bilder angefertigt werden, darf sich das Motiv möglichst nicht bewegen. Bereits kleine Bewegungen (wie etwa Blätter eines Baumes im Wind) können später auf dem HDR-Bild als Geisterbild wahrgenommen werden. Eine HDR-Aufnahme von Menschen und Tieren ist unter der Voraussetzung gar nicht möglich.

Die Aufnahme erfolgt mit der auf das Stativ montierten Kamera. Zur verwackelungsfreien Auslösung benutzt man einen Fernauslöser oder (notfalls) den Selbstauslöser. Wenn man zwischen den Aufnahmen Einstellungen an der Kamera vornimmt, sollte man darauf achten, sie dabei nicht zu bewegen.

Zur Vorbereitung sollten möglichst alle Automatiken abgeschaltet werden. Der Weißablgeich sollte auf die Lichtverhältnisse eingestellt werden, und statt einer automatischen ISO-Einstellung sollte ein fester ISO-Wert gewählt werden. Der Autofokus könnte zwischen den Aufnahmen die Schärfe verstellen und sollte deshalb ebenfalls abgeschaltet werden.

Nun werden die einzelnen Bilder aufgenommen. Es sollten mindestens drei Bilder sein, wovon eines normal belichtet ist und die weiteren entsprechend stark unter- und überbelichtet sind. Im einfachsten Fall geschieht dies über die Belichtungskorrektur oder eine Belichtungsreihe.

Besser ist es aber, die Kamera auf manuelle Belichtung zu stellen, die gewünschte Blende auszuwählen und zunächst einmal die korrekte Belichtungszeit einzustellen. Von hier an kann man alleine durch Verstellen der Belichtungszeit alle notwendigen Bilder anfertigen.

Die Reihenfolge der Aufnahme spielt keine Rolle. Die Kamera legt die Belichtungsdaten im EXIF-Bereich der Bilder ab. Die HDR-Software liest diese Daten später aus und kann die Bilder dann entsprechend einordnen.

Die Software

Da HDR-Bilder per Definition eine sehr hohe Dynamik haben, ist eine Bearbeitung mit herkömmlichen Grafikprogrammen nur sehr eingeschränkt möglich. The GIMP zum Beispiel bietet derzeit nur 8 Bit pro Farbkanal und kann deshalb mit dem hohen Kontrastumfang nicht umgehen.

Anders sieht es schon mit CinePaint aus, einem GIMP-Ableger, der auf Foto- und Filmnachbearbeitung spezialisiert ist, und den es mittlerweile auch schon im Fedora-Repository gibt. Allerdings bietet Cinepaint bisher kein Tonemapping an, sondern kann nur aus den Vorlagefotos das HDR-Bild errechnen.

Qtpfsgui ist dagegen ein Programm, welches ausschließlich für HDR-Bilder gemacht wurde.

Nach der Installation des RPMs kann Qtpfsgui über den Menüeintrag Anwendungen → Grafik → Qtpfsgui gestartet werden. Das Programm gibt es momentan nur in Englisch.

Die Bedienung

Begonnen wird die Arbeit mit dem Erzeugen einer neuen HDR-Datei über den Button “New Hdr…”. In dem folgenden Dialog werden dann im ersten Schritt alle Vorlagebilder eingelesen, aus denen das HDR-Bild zusammengesetzt werden soll.

Über “Next >” gelangt man dann zum zweiten Schritt. Die voreingestellten Parameter können normalerweise so übernommen werden. Qtpfsgui bietet außerdem eine Option “Anti-ghosting” an, welche die Geisterbilder, die durch Bewegungen im Motiv entstanden sind, mehr oder weniger erfolgreich herausrechnen kann.

Ein erneuter Klick auf “Next >” erzeugt nun das HDR-Bild. Der Dialog kann mit “Finish” beendet werden.

Auf dem Monitor erscheint das HDR-Bild in einer speziellen Darstellungsweise. Da der Monitor nicht den kompletten Kontrastumfang wiedergeben kann, wird der Kontrast gestaucht. Das Histogramm über dem Bild gibt den dargestellten Kontrastbereich an und erlaubt es, mit der Maus einen anderen Bereich zur Dastellung auszuwählen. Man kann das Bild außerdem skalieren und drehen. Schließlich wird es über “Save Hdr as…” abgespeichert.

Als nächster Schritt wird nun das oben bereits erwähnte tonemapping vorgenommen. Dazu wird über “Tonemap the Hdr” ein neuer Dialog geöffnet. Auf der linken Seite des Dialogs lassen sich die Bildgröße, die Gammavorkorrektur, der Tonemap-Operator und dessen Parameter einstellen. Es stehen verschiedene Operatoren (“Fattal”, “Ashikhmin” usw.) zur Verfügung, welche über den entsprechenden Reiter ausgewählt werden und zum Teil sehr unterschiedliche Ergebnisse liefern. Mit “Apply” wird aus den aktuellen Einstellungen ein Bild errechnet.

Mit diesen Parametern kann man nun spielen, bis man ein schönes Bild erhält. Es gibt dafür keine Patentlösung. Entscheidend ist alleine der Geschmack und die Erfahrung des Anwenders. Das fertige Bild kann dann als LDR-Bild über “Save” in verschiedenen Formaten (für gewöhnlich JPEG oder verlustfrei als PNG) abgespeichert werden.

RAW-Bilder

Wie oben erwähnt, müssen für HDR-Fotos gewöhnlicherweise mehrere Bilder aufgenommen werden, wodurch sich bewegende Motive (zum Beispiel Personen) nicht fotografiert werden können. Unter einer bestimmten Voraussetzung geht es allerdings schon.

Digitalkameras der gehobenen Preisklasse bieten die Möglichkeit an, die Sensor-Rohdaten als RAW-Datei abzuspeichern. Der Sensor der Kamera verarbeitet einen höheren Kontrastumfang, als später im fertigen JPEG-Bild abgelegt wird. In der RAW-Datei gehen diese Informationen nicht verloren, wodurch solche Aufnahmen auch nachträglich am Computer um bis zu drei Stufen über- oder unterbelichtet werden können.

Und damit eignen sich RAW-Dateien ideal für HDR-Fotos. Der Vorteil liegt auf der Hand: Statt mehrere Fotos mit unterschiedlichen Belichtungen anzufertigen, braucht man nur noch ein einziges Foto - und kann so auch in schwierigen Situationen noch HDR-Bilder machen. Außerdem lassen sich RAW-Fotos aus dem Fotoarchiv in HDR-Bilder wandeln, wo man bei der Aufnahme noch gar nicht an diese Möglichkeit dachte.

Der Kontrastumfang einer RAW-Aufnahme kann sich allerdings nicht mit einer manuell belichteten Reihe messen. Bei meinen Tests wurde außerdem das Rauschen des Bildsensors erheblich verstärkt und fiel durch Pixelraster störend auf. Wenn möglich, sollte man also die manuelle Belichtung oder eine Kombination aus beidem bevorzugen.

Qtpfsgui kann übrigens die RAW-Bilder vieler Kameramodelle direkt einlesen, so dass eine vorherige Konvertierung entfällt.

Danksagungen

Danke an Jörg Hellmich für den Hinweis auf Qtpfsgui und die Inspiration zu diesem Artikel.

Die Fotos stammen von Dean S. Pemberton und wurden bei Wikipedia unter der Creative Commons License veröffentlicht: Bild 1, Bild 2.

Wenn man weite Landschaften wie Berge oder das Meer in einem Foto festhalten möchte, fertigt man normalerweise ein Panoramafotos an. Dazu braucht man keine teure Ausrüstung. Es reicht bereits eine handelsübliche, einfache Digitalkamera, eine Software und ein wenig theoretisches Wissen, um durchaus vorzeigbare Ergebnisse zu erzielen. Dieses Fedorablog-Special zeigt, wie es geht.

Ein wenig Theorie

Panoramafotos sind Bilder, die zu breit sind, um sie mit einem normalen Objektiv in einer Aufnahme aufzunehmen. Um sie trotzdem mit der Kamera zu erfassen, greift man zu einem simplen Trick: Man macht mehrere Fotos und schwenkt die Kamera dabei immer ein Stück weiter. Zuletzt setzt man die einzelnen Bilder dann zu einem großen Bild zusammen. Früher waren es noch Papierabzüge, die man mit Klebestreifen passend aneinander klebte. Heute macht man das natürlich digital mit Unterstützung vom Computer.

Die Qualität des späteren Panoramabildes hängt von der Qualität des Ausgangsmaterials ab. Die Fotos, die nachher bearbeitet werden sollen, müssen bereits möglichst gut geeignet sein. Der Computer kann zwar den einen oder anderen Fehler verstecken, aber je besser die Vorlage ist, desto besser ist nachher auch das Ergebnis.

Dabei hilft schon, auf möglichst viele Automatismen der Kamera zu verzichten. Der automatische Weißabgleich zum Beispiel kann dazu führen, dass die einzelnen Bilder die Farben unterschiedlich wiedergeben und das Gesamtbild dadurch auffällige, fließende Farbverläufe bekommt. Man sollte möglichst einen festen, zu den Lichtverhältnissen passenden Weißabgleichsmodus verwenden (zum Beispiel “Tageslicht”). Wenn man genügend Erfahrung hat, sollte man auch manuell belichten, damit die Einzelfotos gleich belichtet sind. Die Brennweite (der “Zoom”) darf natürlich erst recht nicht verstellt werden, wenn man mit der Bilderserie angefangen hat.

Wichtig, aber schwierig ist es, die Kamera nach jeder Einzelbildaufnahme richtig zu schwenken. Idealerweise bestimmt man dafür den so genannten Nodalpunkt, der von Kameramodell und Objektiv abhängig ist. Das erfordert nicht nur ein erfahrenes Auge, sondern auch ein Stativ mit einem speziellen und teuren Panoramakopf. Für den Hobbyfotografen ist das eher unerschwinglich.

Ein einfaches Stativ reicht für brauchbare Ergebnisse aber meistens schon aus. Man schwenkt einfach die Kamera Stück für Stück auf dem Stativ weiter und nimmt die Einzelfotos. Mit ein wenig Übung kann man sogar aus freier Hand ganz passable Panoramas schießen. Als Faustregel gilt, das Kameraobjektiv nur zu drehen, aber möglichst wenig zu bewegen. Es darf auch kein Objekt zu nahe an der Kamera stehen, da es sich sonst in den Einzelaufnahmen zum Hintergrund verschiebt und nachher ein nahtloses Zusammensetzen des Panoramas fast unmöglich macht.

Die einzelnen Bilder, die man aufnimmt, sollten sich stets gut überlappen. Das Folgebild sollte immer etwa die Hälfte des vorherigen Bildes beinhalten. Arbeitet man hier zu knapp, hat man später Verzerrungen und Abschattungen (Vignettierungen), die störend im Panoramabild auffallen können. Manche Kameras bieten dazu einen Panoramaassistenten, bei dem man immer eine Bildhälfte des zuletzt gemachten Bildes sieht und live das nächste Bild passend daran ansetzt.

Panoramafotografie ist ein Fotografie-Kapitel für sich. Weitere Details würden den Artikel sprengen. Am Ende gibt es aber noch ein paar weiterführende Links.

Stitching

Im nächsten Arbeitsschritt müssen die einzelnen Fotos zu einem Panoramabild zusammengesetzt werden. Man nennt diesen Vorgang stitching. Eine passende Software, die kürzlich in das Fedora-Repository aufgenommen wurde, ist Hugin. Diese wiederum benutzt Enblend, um die Einzelbilder schließlich zu einem Gesamtbild zusammenfügen.

Die Software ist mit yum schnell installiert:

yum install hugin enblend

Hugin kann anschließend unter Anwendungen > Grafik gestartet werden.

Im Prinzip ist die Bedienung der Software kinderleicht. Als erstes lädt man die einzelnen Bilder ein und bringt sie in die Reihenfolge, in der sie nachher zusammengesetzt werden sollen (meistens von links nach rechts). Wenn alle Bilder geladen und sortiert sind, wählt man das Ankerbild aus. Normalerweise ist es das mittlere Bild. Dieses wird mit “Positionsanker setzen” ausgewählt. In der Bildertabelle ist es in der Spalte Anker mit einem “A” markiert.

Danach folgt das Vernähen im Reiter “Kontrollpunkte”. Dort wählt man zuerst zwei benachbarte Bilder aus (zum Beispiel auf der linken Seite Bild 1 und auf der rechten Bild 2). Dann klickt man mit der Maus auf einen markanten Punkt eines Bildes (ein Gegenstand, eine Ecke, ein auffälliger Stein oder ähnliches), und wählt im anderen Bild den gleichen markanten Punkt aus. Es folgt eine Vergrößerung, in der man diese beiden Punkte nachjustieren kann; fast immer hat die Software aber schon die genaue Position selbst gefunden. Mit “Hinzufügen” kann dieses Punktepaar dann in die Liste aufgenommen werden. Man sieht danach wieder die beiden Vollbilder, bei denen das Punktepaar durch gleichfarbige Kreise markiert ist.

Auf diese Art müssen mehrere markante Punktpaare eingegeben werden; je mehr und je weiter über das gesamte Bild verteilt, desto besser das Endergebnis. Fünf Paare sollten es mindestens sein. Danach wählt man die nächsten zwei benachbarten Bilder (links Bild 2, rechts Bild 3) und fährt mit der Arbeit fort, bis man das vorletzte Bild mit dem letzten vernäht hat.

Die Arbeit ist damit schon fast geschafft. Als nächsten Arbeitsschritt lässt man Hugit die Punktpaare optimieren. Dazu wechselt man in den Reiter “Optimieren”, wählt dort in der “Optimieren”-Box den Eintrag “Alles” und klickt auf “Jetzt optimieren!”. Die Software rechnet nun kurz und präsentiert ein Ergebnis, das man übernehmen kann.

Es lohnt sich, jetzt einmal die Vorschau zu betrachten. Diese erreicht man über das Menü unter Ansehen > Vorschaufenster. Besonderes Augenmerk sollte man auf die Nahtstellen legen. Wenn dort Sprünge sichtbar sind, muss man zurück zu den “Kontrollpunken” und an den entsprechenden Stellen weitere Punktpaare einfügen.

Die Vorschau dient auch dazu, die Bildmitte und den Bildausschnitt festzulegen. Mit “Zentrieren” und “Einpassen” kriegt man bereits eine gute Vorlage. Allerdings sieht der Rand des Panoramas durch die Einzelbilder ein wenig bauchig und gezackt aus. Mit den Schiebern rechts von und unter der Vorschau kann man aber den Bildwinkel und damit den Ausschnitt verstellen und so zum Beispiel auch die Ränder entfernen.

Wenn die Vorschau nun das gewünschte Ergebnis liefert, werden im letzten Schritt die Bilder zu dem endgültigen Panoramabild zusammengefügt. Dazu wählt man den Reiter “Zusammenfügen”. Unter “Bilder zusammenfügen” kann man das Bildformat auswählen, zum Beispiel “in ein hochwertiges JPG-Bild”. Mit “Jetzt zusammenfügen!” wird dann die Panoramadatei erzeugt und abgespeichert. Das kann je nach Umfang der Bilder und der Geschwindigkeit des Rechners durchaus ein paar Minuten dauern.

Danach ist das Panoramafoto fertig! Es empfiehlt sich trotzdem, die Hugin-Projektdatie zu sichern, falls man nachträglich noch kleine Korrekturen vornehmen möchte.

Links

- Ein Workshop zur digitalen Panoramafotografie von digitalkamera.de

- Eine Anleitung, wie man den Nodalpunkt findet von digitalkamera.de

- Panoguide ist eine ganze Website, die sich alleine dem Thema Panoramafotografie widmet, allerdings in Englisch.